Projekt

Barrierefreie Augmented Reality Wegführung im öffentlichen Nahverkehr

Ziel war eine einfache, schnell erfassbare und verständliche Wegführung, die Navigations Apps wie Google Maps, um Augmented Reality erweitert.

Betreuer

Prof. Dr. Frank Heidmann

Kursinhalt

Theoretisch-, methodisch- und gestalterische Grundlagen der Mensch-Computer Interaktion, »Human-Centered Design« und »UX Design«. Sowie Theorien und Methoden zur Konzeption, zum Prototyping und zur Evaluation.

Datum

2022 – Fachhochschule Potsdam

01

Herausforderung

Viele Wege führen zum Ziel. Zu viele, welche man jedes Mal neu

heraussuchen muss. Das geht einfacher. Einige Wege werden nicht angezeigt, wie Schienenersatzverkehr. An einem Bahnhof, den man nicht kennt, ist man schnell überfordert.

Google Maps macht das gut, bringt jedoch eigene Probleme mit sich. Auch die Barrierefreiheit ist nicht gegeben. Eine leichtere Zielführung muss her, die den Nutzer kennenlernt und ihm den Weg weist.

Potenzielle Stakeholder

Pendler, Reisende, Schulkinder, Studenten, Arbeiter. Menschen, die sich nicht auskennen und den öffentlichen Nahverkehr nutzen. Die lokale Sprache nicht verstehen. Barrierefreiheit brauchen. Den schnellsten Weg zum Ziel suchen.

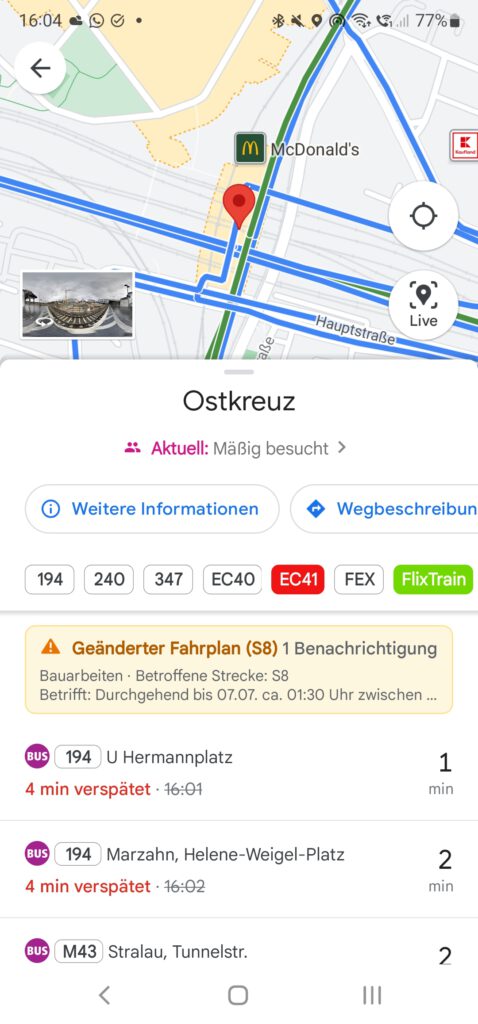

größte Usability/UX Probleme

Es ist kein genauer Weg sichbar. An einem großen Bahnhof wird dem Nutzer nicht angezeigt, wo sich sein zu oder Bus befindet.

Typische Szenarien

Ein Tourist sucht einen Zug zum BER. Er spricht die deutsche und

englische Sprache nicht und braucht Unterstützung beim finden des

Richtigen Zuges und dem Weg dazu.

02

Quantitative Recherche

Vorgehen

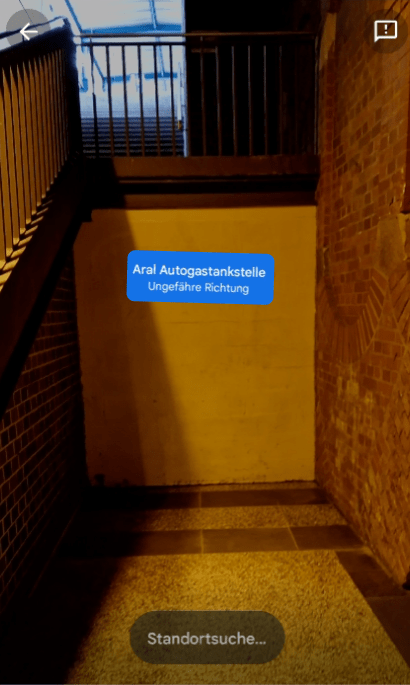

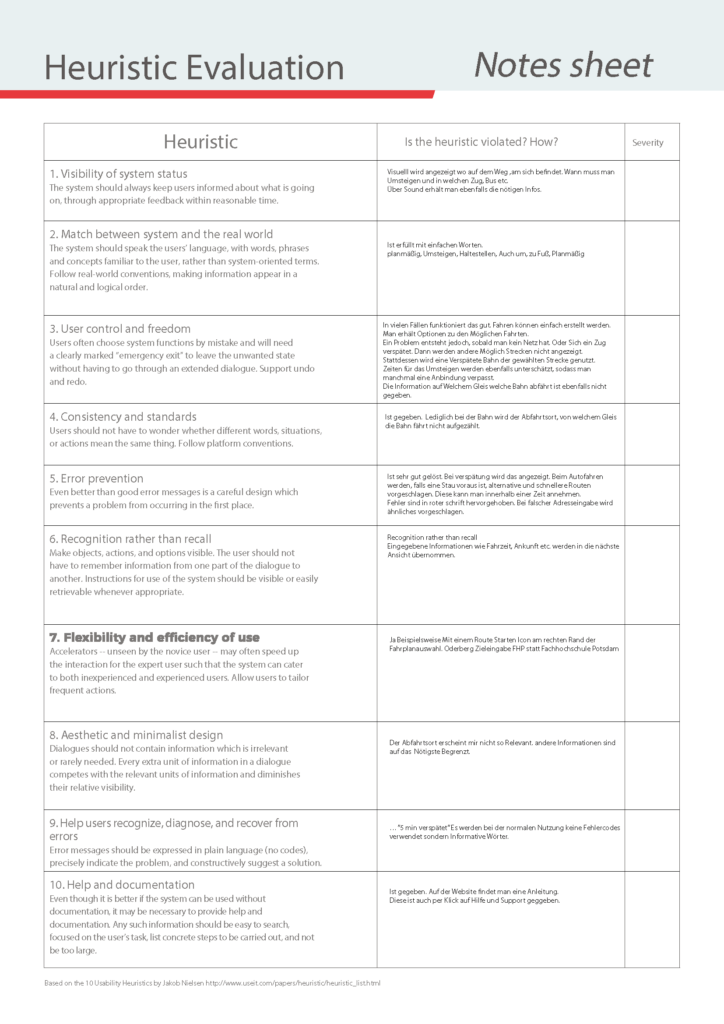

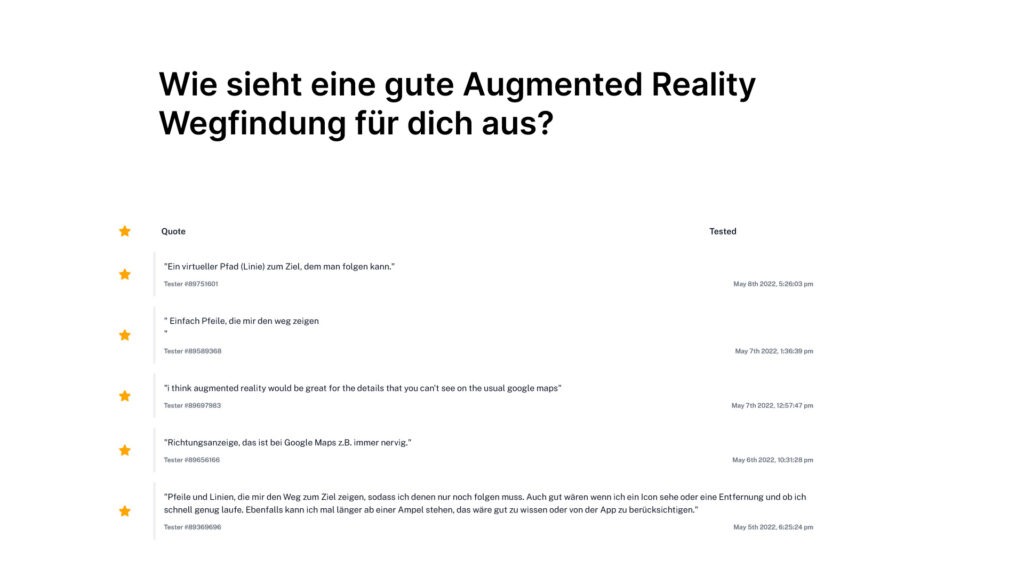

Mittels heuristischer Evaluation habe ich die Google Maps App geprüft und hier einige Schwachstellen festgestellt. Besonders bei der Wegführung. Nachgehend habe ich recherchiert, wie Wegführung funktioniert. Welche verschiedenen Darstellungen es gibt und welche am besten in AR passen. Zunächst habe ich dann eine Umfrage erstellt, um herauszufinden, welche Darstellung die Stakeholder am geeignetsten finden und wo die größten Painpoints liegen.

Dazu habe ich untersucht, welche Arten der Navigation es gibt und wie diese Dargestellt werden. Beispielsweise in Videospielen, Apps, im Alltag am Bahnhof (analog und digital) und in Autos.

Erkenntnisse

- AR in Navigations Apps sollte verbessert werden

- wichtigste Infos: schnellster Weg, wann starten, Orientierung

- Wegfindung zum Zug sollte vereinfacht werden

- Wegfindung zum Bus sollte definitiv verbessert werden

- AR wird bereits von vielen Studenten benutzt

- Pfeile und Linien zum Ziel sowie Icon mit Entfernung und Richtungsanzeige Funktioniert am besten

03

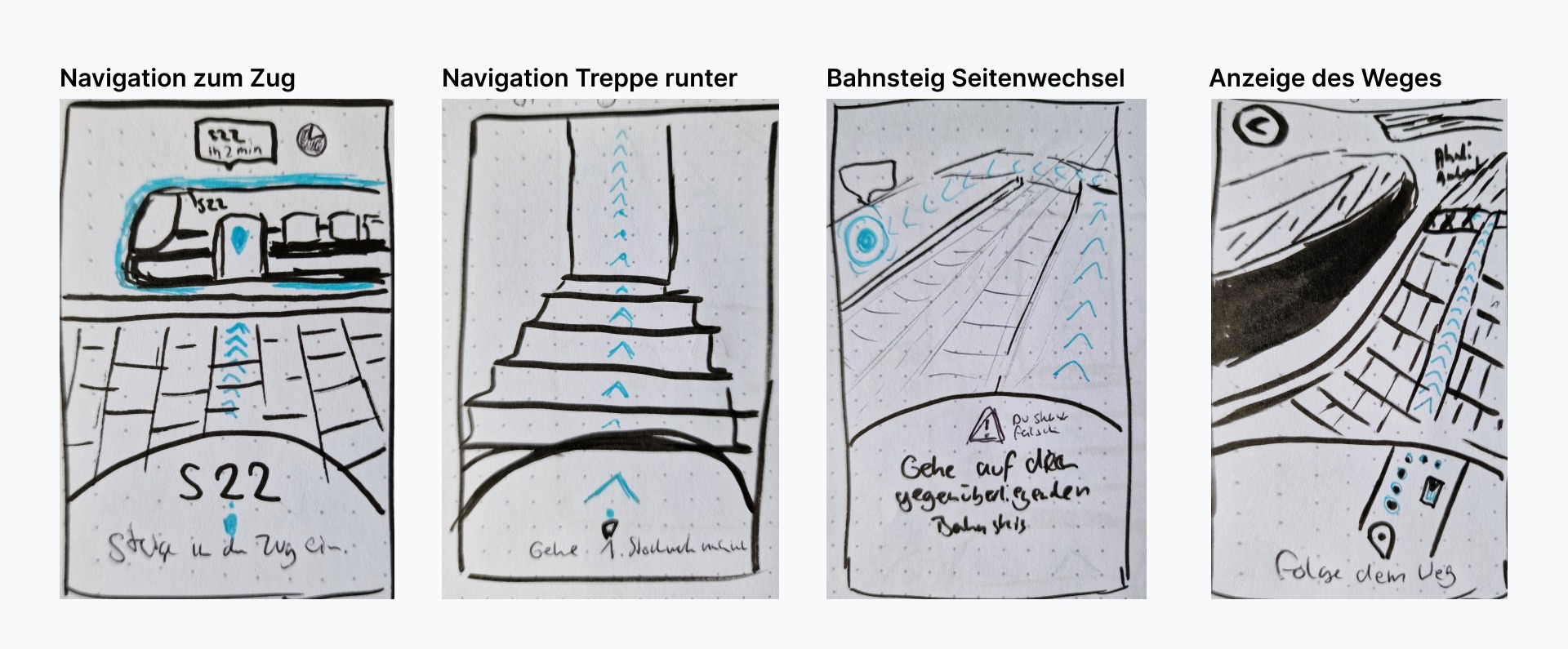

AR Wegführung

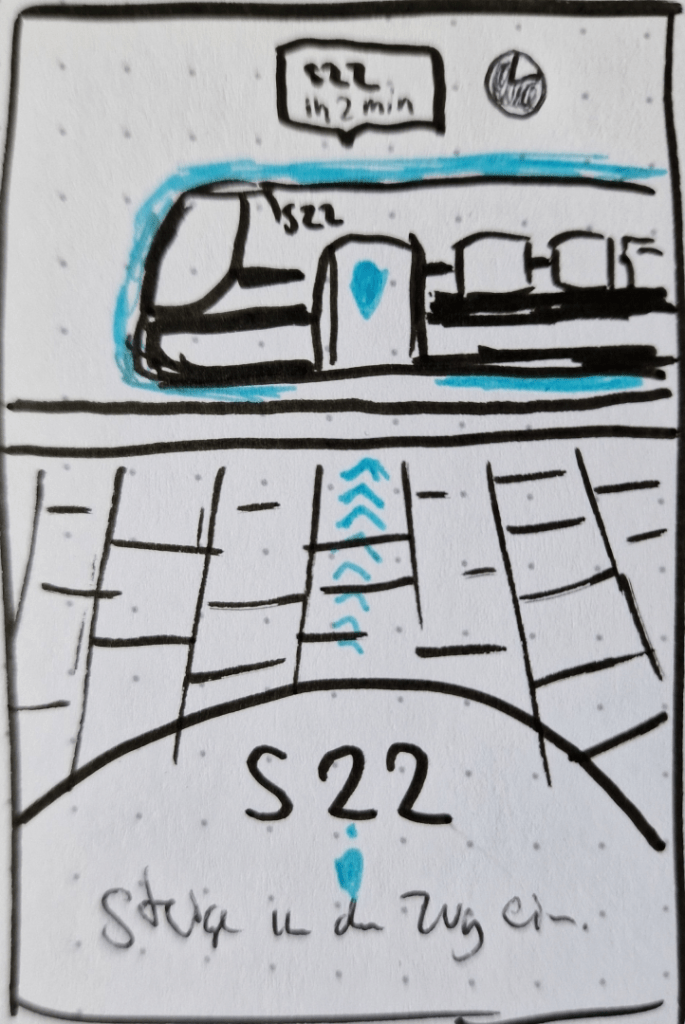

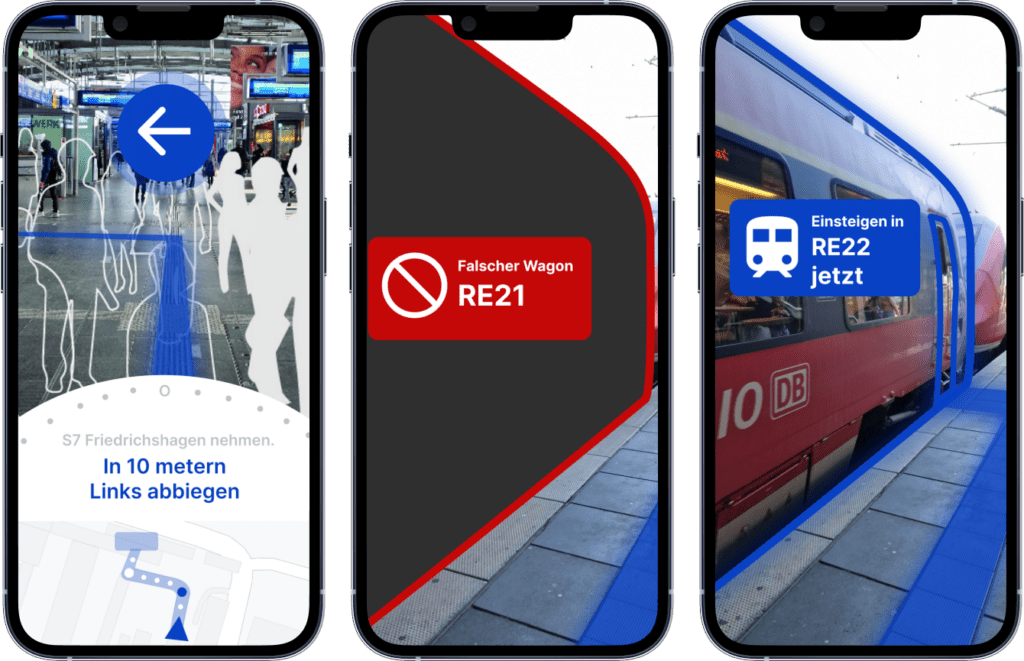

Aufgrund meiner Recherche ergab sich ein Schema bereits verwendeter Konzepte, die ich dann kombiniert und auf die App angepasst habe.

Schnell erfassbar

Eine Navigationsspur am Boden, welche den Weg hervorhebt. Chevron Pfeile bewegen sich animiert in die jeweilige Laufrichtung. Durch eine Zaunartige Absperrung wird der richtige Weg deutlicher. Bei Kurven verschwindet je nach Perspektive ein wichtiger Teil, welcher durch Pfeile darüber zusätzlich gekennzeichnet wird. Dieser hat eine dezente Animation.

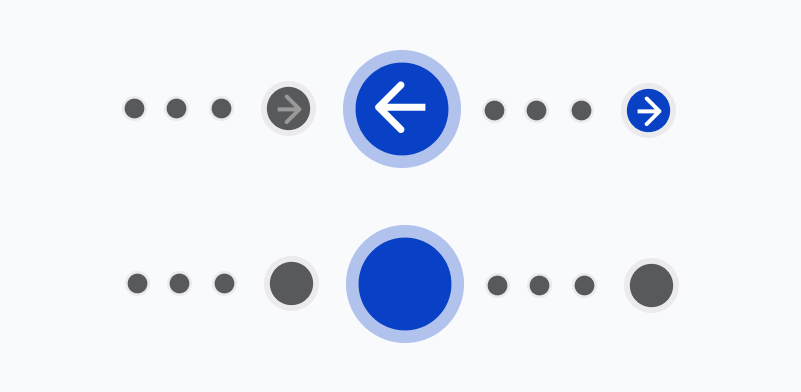

Checkpoints

Dieser verschwindet, sobald man ihn einsammelt und wird in der Karte und VR der App zu einem grauen Punkt. Der nächste Checkpoint wird blau und größer.

Gestalterische Differenzierung zwischen Weg und Checkpoint (Aktuell, Abgeschlossen, nächster)

Das Einsammeln der Checkpoints gestaltet durch Gamification den Weg interessanter. Bereits bevor man den Checkpoint erreicht hat, sollte der nächste weniger dominant angezeigt werden, um sich darauf vorzubereiten.

Natürliche Wegführung

Nicht immer möchte man sein Handy hochhalten. Der Wechsel von 2D zu AR sollte mit Swipe, Button und Bewegung des Handys möglich sein.

So wird die Kamera ausgeschaltet und spart Energie. Auf unübersichtlichen Bahnhöfen kann man schnell den Weg verständlich über AR angezeigt bekommen, ohne es aktiv einzuschaulten zu müssen. Sobald bessere Devices für die Nutzerführung Markttauglich werden, sollte man diese ebenfalls beachten. Smartwatches und Smartglasses bieten hier Potenzial.

03

Qualitative Recherche

A/B-Testing

A: Um nahe Menschen vor einer Kollision zu schützen, werden diese deutlicher dargestellt, desto näher man ihnen kommt. Andere werden ausgeblendet.

B: Mittels Live-Filter werden Menschen durchsichtig dargestellt und mit einer Kontur umrandet. Dadurch sieht man den Boden.

Ergebnis: Zu nahe Menschen sind nicht erkennbar.

Menschen, wenn ausgefüllt bedecken zu viel,

Kontur ist besser.

Lösung

Markierung

Weg zur Tür vom Zug ist markiert. Infos zum Zug sind im AR und UI erkennbar. Auch Sitzplatz bei Reservierung oder ein barrierefreier Platz könnte hier angezeigt werden.

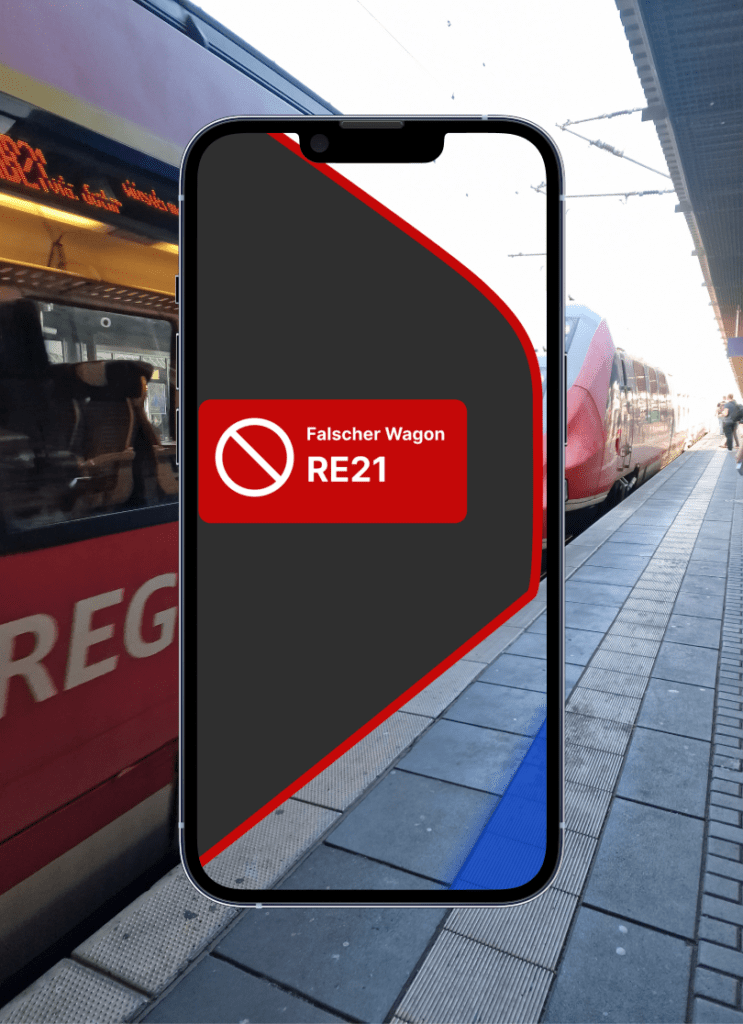

Falscher Zug

Zug wird farblich ausgegraut, Icon weist auf falschen Zug bei der Tür hin.

Neue Kenntnisse

Mittels heuristischer Evaluation konnte ich eine Vielzahl von Problemen vorab identifizieren. Durch User Research und Fragebögen wurden die wichtigsten möglichen Verbesserungen identifiziert. Durch Use Cases konnte ich mich in verschiedene Menschen hineinversetzen und so aus deren Perspektive mögliche Szenarien erstellen.

Low-Fidelity Prototypes eignen sich besser zum Testen von Szenarien, da die Stakeholder auf Konzepte fokussieren. Zudem sind diese kostengünstig, schnell erstellt.